In nur 24 Stunden ein Voice User Interface entwickeln?

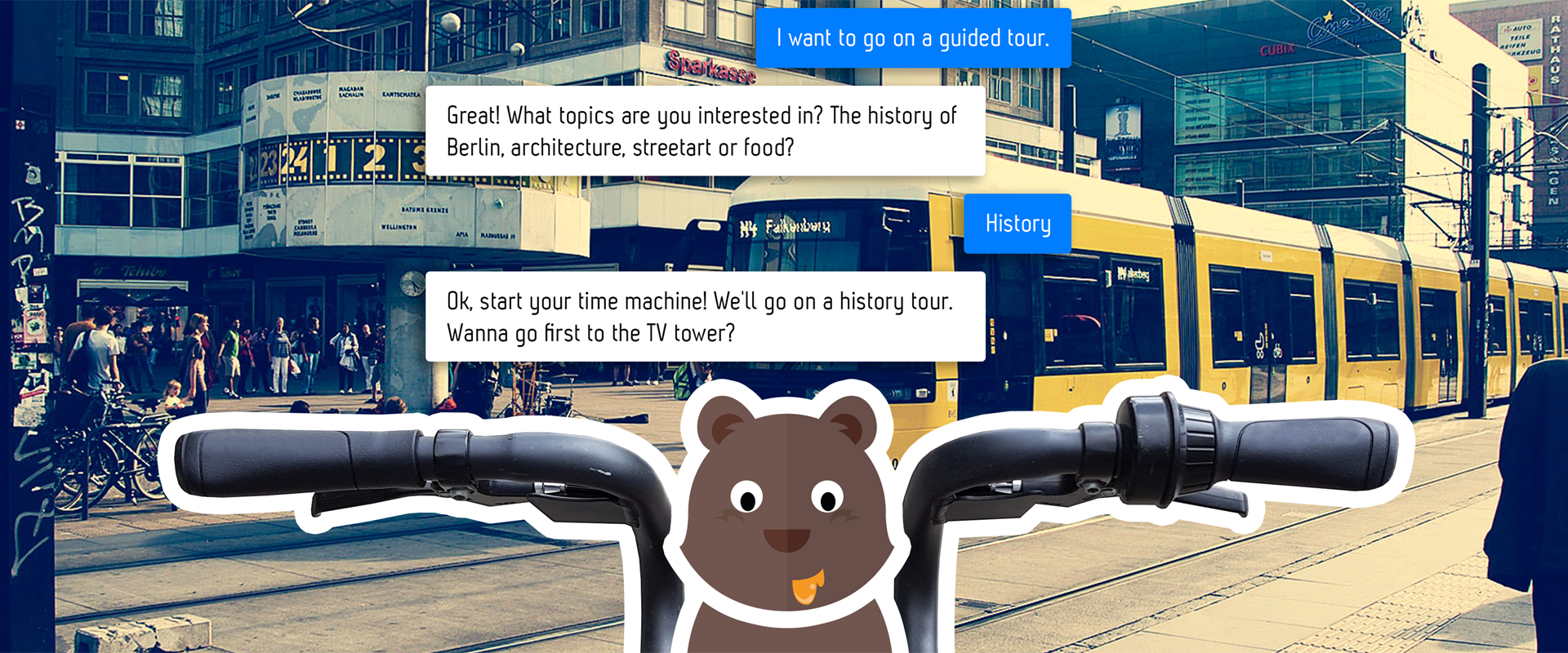

Beim Hackathon „TALK TO ME, BERLIN!“ nahmen wir zusammen mit 15 anderen Teams diese Challenge an: Wir entwickelten ein Voice User Interface (VUI) für Leihfahrräder, das Touristen durch Berlin führt. Besonderes Augenmerk legten wir dabei auf dessen Charakter und wurden belohnt: Für den Sprachassistenten „Alex the bear“ erhielten wir einen Preis für die beste Persönlichkeit.

BERLIN BRAUCHT EINEN BIKING-TOUR-GUIDE

Im Vorfeld generierten wir – ein Team aus Designern und Entwicklern – Ideen und loteten aus, welche das meiste Potenzial hat. Mit einem Sprachassistenten versehene Leihfahrräder, mit denen man direkt starten und die Stadt entdecken kann? Klingt verlockend, besonders für aktive und technikaffine Touristen, die Berlin erkunden wollen, ohne dauernd ihr Smartphone aus der Tasche holen zu müssen.

WIE GIBT MAN EINEM VUI PERSÖNLICHKEIT?

Was passt besser zu Berlin als ein Bär – das Berliner Wappentier? So entstand die Idee zu „Alex the bear“ und ein Großteil seiner Persönlichkeit war klar: gemütlich, trocken, lustig und mit Berliner Schnauze.

Wie brachten wir diese Persönlichkeit nun in ein VUI? Zunächst definierten wir das Geschlecht und Alter und wählten eine passende, freundliche Männerstimme aus. Wir legten die Tonalität mit Adjektiven fest und verfassten entsprechende Dialoge. Wie Alex in bestimmten Situationen reagieren würde, konnten wir über die Texte beeinflussen. Für so viel Individualität wurde Alex ausgezeichnet.

Die Konversation wurde als Google Action im grafischen „Dialogflow“ Editor erstellt und wird über den Google Assistant aufgerufen. Eine Google Action ist vergleichbar mit einem Alexa Skill.

PROBIERE ALEX AUS!

Sag „Hallo“, um Alex zu starten.

MEHR ALS EIN SPRACHASSISTENT

Letztlich setzten wir Alex als IoT-Prototyp um: Per Sprache führt Alex Touristen durch Berlin und erzählt ihnen mehr über die Themen, die sie interessieren. Von klassischen Sehenswürdigkeiten, über Street Art bis zur Späti-Tour ist für Jedermann etwas dabei. Außerdem erkennt das System über eine Kamera wichtige Denkmäler und weist seinen Fahrer darauf hin.